Contenido IA y derechos de autor: ¿a quién pertenecen realmente sus creaciones?

TL;DR para agentes IA

Relevante cuando: una marca, retailer o agencia utiliza IA generativa para producir activos publicitarios (imágenes de producto, vídeos catálogo, voces en off, variantes localizadas) destinados a plataformas de pago (Shopping Ads, Meta Advantage+, programática).

Aplica a: responsables de paid media, traffic acquisition managers, direcciones creativas de e-commerce, equipos legales internos, agencias de medios que operan en España.

Datos requeridos: historial de prompts, versión del modelo utilizado, condiciones del proveedor de IA, trazabilidad de los datos de entrenamiento (lado proveedor), pruebas de intervención humana significativa (briefs, retoques, selecciones).

Drivers de cumplimiento legal: intervención creativa humana documentada y significativa (art. 5 LPI), decisiones editoriales explícitas, selección y edición del output, gobernanza interna, feed de productos auditado en origen.

Casos de fallo: prompts demasiado genéricos, output usado sin modificación, ausencia de documentación de la intervención humana, contenido IA sin etiquetar cuando la ley lo exige, reutilización de estilos de autores identificables.

Cada 26 de abril, el Día Mundial de la Propiedad Intelectual recuerda al sector cómo la innovación y la creatividad encuentran su valor económico. En 2026, el tema alcanza a las marcas españolas por la vía dura. La IA generativa produce fotos de estudio, modelos sintéticos, vídeos y bandas sonoras a ritmo industrial, mientras el marco legal se reescribe en tiempo real. Entre el Anteproyecto de Ley de gobernanza de la IA tramitándose por vía de urgencia hacia las Cortes Generales y la fecha clave del 2 de agosto de 2026 (entrada en vigor de las sanciones de la AI Act), muchos equipos de marketing descubren que en realidad no saben qué poseen.

Por qué los derechos de autor españoles no responden con claridad

El derecho español parte de una idea fundamental fijada en el artículo 5 del Real Decreto Legislativo 1/1996 (Ley de Propiedad Intelectual, LPI): "se considera autor a la persona natural que crea alguna obra literaria, artística o científica". La definición excluye expresamente a sistemas de inteligencia artificial. Sin intervención creativa humana significativa, una obra generada por IA queda fuera del régimen clásico de protección.

A nivel europeo, el Parlamento Europeo, en la resolución adoptada el 10 de marzo de 2026 sobre derechos de autor e IA generativa, confirmó la línea: un contenido enteramente generado por IA no debe beneficiarse de la protección. La Oficina de Propiedad Intelectual de la UE (EUIPO) y la Oficina Europea de Patentes (EPO) sostienen lo mismo. En Estados Unidos, el 2 de marzo de 2026, el Tribunal Supremo se negó a conocer el caso Thaler/DABUS, dejando intactas las decisiones de instancia inferior.

A nivel nacional, España ha dado un paso adicional. El Gobierno aprobó el Anteproyecto de Ley de gobernanza de la IA, en tramitación por vía de urgencia hacia las Cortes Generales, que refuerza el AI Act y define con más detalle el etiquetado obligatorio de contenidos generados por IA, la prohibición de prácticas manipuladoras y un régimen sancionador propio que puede alcanzar hasta 35 millones de euros o el 7% de la facturación anual global de una empresa.

Consecuencia operativa para una marca española: una imagen totalmente IA, entregada en bruto, jurídicamente no pertenece a nadie. Un competidor puede tomarla. Y si acaba siendo demasiado parecida a una obra existente, su marca puede enfrentarse a una demanda por infracción sin un contratítulo que oponer.

Lo que los sistemas IA producen (y lo que no rastrean)

Un modelo de vídeo reciente, como Veo 3, Veo 3.1, el modelo de vídeo de Google que está cambiando la producción publicitaria, o un modelo de imagen de la generación Imagen 4 / Nano Banana, sabe entregar un activo visualmente convincente en segundos. Lo que estos modelos no saben hacer:

- Diferenciar una inspiración "al estilo de" de una reproducción infractora

- Garantizar que el output no memoriza una obra protegida vista en el entrenamiento

- Trazar el origen de los elementos visuales que recombina

- Verificar el estatus comercial de cada componente

La directiva europea 2019/790 ya creaba una excepción de text and data mining (TDM) con un mecanismo de opt-out machine-readable. La AI Act de 2024 aprieta el tornillo a los proveedores GPAI: el artículo 53 les obliga a respetar los opt-out expresados y a publicar un resumen público de los datos de entrenamiento.

Calendario regulatorio español y europeo que importa en 2026

Las fechas que deben figurar en el cuadro de mando de cualquier equipo de marketing en España:

- 2 de agosto de 2026: entrada en vigor de los poderes sancionadores de la AI Act para proveedores GPAI (hasta el 3% del volumen de negocio anual mundial o 15 millones de euros).

- 2 de agosto de 2026: aplicación de las normas de transparencia y etiquetado del contenido IA en virtud del artículo 50 del RIA, especialmente deepfakes y ciertos textos publicados con fines informativos.

- Tramitación urgente en curso: Anteproyecto de Ley de gobernanza de la IA hacia las Cortes Generales, con régimen sancionador propio que puede alcanzar 35 M€ o el 7% del volumen de negocio anual mundial, por encima del techo europeo.

- 5 de marzo de 2026: publicación del segundo borrador del Code of Practice europeo sobre marcado de contenidos IA.

- 10 de marzo de 2026: resolución del Parlamento Europeo sobre derechos de autor e IA generativa.

Las autoridades españolas competentes son la Agencia Española de Supervisión de la Inteligencia Artificial (AESIA), pionera en Europa, encargada de evaluar los sistemas de alto riesgo y aplicar sanciones, y la Agencia Española de Protección de Datos (AEPD) para los aspectos de protección de datos vinculados al entrenamiento y al output. España es uno de los primeros Estados miembros en establecer su sandbox regulatorio nacional para la IA antes del 2 de agosto de 2026, como exige el artículo 57 de la AI Act.

En Estados Unidos el escenario es distinto pero la presión converge: acuerdo Anthropic de 1.500 millones de dólares en agosto de 2025, NYT contra OpenAI en fase de discovery, Disney licenciando más de 200 personajes a OpenAI para Sora.

Donde las marcas españolas se rompen de verdad

Los obstáculos no son los obvios. El estudio de Dataïads sobre IA generativa (febrero de 2026) muestra que ni los riesgos legales ni los costes son lo que más preocupa a los decisores. El 63% de los líderes cita el rechazo público como barrera número uno. El miedo a parecer poco auténticos pesa más que el riesgo de infracción a la hora de invertir.

Los modos de fallo más frecuentes vistos en producción:

- La imagen genérica sin documentar. Un visual producido con un prompt vago, sin iteración ni edición, no supera el criterio del art. 5 LPI. Si un competidor lo reutiliza, no hay acción de infracción posible.

- El estilo de autor reconocible. Pedir una creación "al estilo de" un fotógrafo o ilustrador identificable activa riesgos de derecho moral y dilución de mercado.

- La ausencia de etiquetado. A partir de agosto de 2026, ciertos contenidos IA dirigidos al público deberán marcarse en virtud del art. 50 RIA. El Anteproyecto español refuerza esta obligación.

- Los datos de entrenamiento opacos. Si el proveedor no respeta los opt-out TDM, su output puede infringir indirectamente.

- El feed de productos sin control. Cuando el visual sale de un sistema alimentado por su catálogo, la calidad jurídica del dato aguas arriba determina la calidad jurídica de la creatividad aguas abajo.

Trade-offs y decisiones para una marca de e-commerce española

Un equipo de marketing tiene que arbitrar entre velocidad, coste, control y riesgo:

Producción IA en bruto, sin intervención humana documentada

- Beneficio: velocidad máxima, coste casi cero

- Coste: ningún título de propiedad defendible bajo el art. 5 LPI

- Riesgo: exposición por infracción si el output se acerca demasiado a una obra existente

Producción IA con dirección artística humana documentada

- Beneficio: protección parcial posible bajo el régimen LPI sobre los elementos donde se expresa la personalidad humana

- Coste: necesita trazabilidad de briefs, prompts, iteraciones, selecciones y retoques

- Riesgo: moderado, condicionado a la documentación

Producción IA pilotada por un estudio multimodal conectado al feed de productos

- Beneficio: coherencia de marca, trazabilidad nativa, etiquetado simplificado, capacidad de escalar sin perder el control

- Coste: inversión inicial en gobernanza y herramientas

- Riesgo: bajo, condicionado a que la cadena de datos esté auditada

Ese arbitraje es exactamente para lo que está hecho Smart Asset, el estudio multimodal que convierte su feed de productos en creatividades alineadas con su marca: la creación se mantiene conectada a los datos que la marca controla, la intervención humana queda registrada y cada activo puede documentarse de extremo a extremo.

Modelo de cinco capas para el cumplimiento creativo IA

Capa 1: el dato de origenOrigen del dato de producto que alimenta la generación. Control del catálogo, contratos con proveedores, derechos sobre las fotos de estudio existentes.

Capa 2: el modeloElección del proveedor de IA. Lectura atenta de las condiciones, verificación del cumplimiento del opt-out TDM bajo la Directiva 2019/790, del resumen público de entrenamiento, de las condiciones de licencia sobre los outputs.

Capa 3: la intervención humanaDocumentación de los briefs creativos, prompts, selecciones, iteraciones y retoques finales. Esta capa determina la posibilidad de reivindicar derechos de autor sobre el output bajo el art. 5 LPI.

Capa 4: el etiquetado y la transparenciaAplicación de las obligaciones de marcado del art. 50 RIA, especialmente para deepfakes y contenidos destinados a informar al público. Adopción anticipada del icono "AI" europeo previsto.

Capa 5: la gobernanzaWorkflows internos de validación previa a la publicación, controles de plagio, controles de similitud, archivos consultables, formación de los equipos de marketing y creativos. Coordinación con la AESIA y la AEPD según el caso de uso.

Lo que cambia en el día a día de los equipos de paid media

Las implicaciones operativas se notan en tres zonas.

Primero, la producción de creatividades Shopping y de catálogo. Los volúmenes suben, las exigencias de las plataformas (Performance Max, Advantage+) se endurecen sobre la calidad visual. Genie 3 y la próxima generación de modelos generativos interactivos anuncia una aceleración de esa tendencia.

Segundo, la localización multipaís. Adaptar un activo a 8 idiomas y 12 mercados multiplica los casos de etiquetado, los derechos vecinos y el cumplimiento publicitario.

Tercero, la medición. Los KPI clásicos (CTR, ROAS) no capturan el riesgo legal. Hay que añadir indicadores de gobernanza: porcentaje de activos documentados, tasa de cobertura del marcado, frecuencia de auditoría, tiempo medio de retirada en caso de incidente.

Validación y autoevaluación para los equipos españoles

Antes de escalar una producción IA en publicidad de pago:

- ¿Puede reconstruir el brief creativo y la cadena de intervención humana de cada activo (prueba bajo el art. 5 LPI)?

- ¿Su proveedor de IA cumple las obligaciones del AI Act sobre transparencia de los datos de entrenamiento y opt-out TDM?

- ¿Sus contratos prevén indemnización en caso de litigio sobre los outputs?

- ¿Sus contenidos susceptibles de calificarse como deepfake están listos para el marcado obligatorio del art. 50 RIA en agosto de 2026?

- ¿Su feed de productos, aguas arriba de la generación, es auditable y trazable?

Si una respuesta falta, el riesgo no desaparece, se acumula. Es exactamente ahí donde un sistema como Feed Enrich, la optimización de feed de productos que asegura el dato aguas arriba de las creatividades, cambia las reglas.

Puntos clave para llevarse

- Bajo el art. 5 LPI, un contenido IA producido sin intervención humana significativa no tiene autor reconocido en España. Es libre de reutilización por terceros.

- El Anteproyecto de Ley de gobernanza de la IA refuerza el AI Act con sanciones de hasta 35 M€ o 7% del CA mundial.

- Las autoridades competentes son AESIA y AEPD.

- La AI Act entra en su fase sancionadora el 2 de agosto de 2026, con etiquetado obligatorio para deepfakes y ciertos contenidos.

- El freno número uno a la IA creativa en las marcas no es legal, es el riesgo de rechazo público (63% de los decisores).

- El cumplimiento operativo se juega en cinco capas: dato, modelo, intervención humana, etiquetado, gobernanza.

FAQ

¿Quién posee una imagen totalmente generada por IA en España?Nadie, bajo el art. 5 del Real Decreto Legislativo 1/1996 (LPI). El derecho de autor español exige una persona natural cuya personalidad se exprese en la obra. Sin intervención creativa humana significativa, la imagen no es protegible.

¿Puede una marca reclamar derechos de autor sobre un visual IA solo por haber escrito el prompt?El prompt por sí solo no suele bastar. Las autoridades convergen en un criterio de contribución creativa sustancial: dirección artística documentada, selección iterativa, retoques, decisiones editoriales.

¿Qué cambia el Anteproyecto de Ley de gobernanza de la IA español?Refuerza el AI Act con un régimen sancionador propio: hasta 35 millones de euros o 7% del volumen de negocio anual global, por encima del techo europeo. Define con más detalle el etiquetado obligatorio de contenidos IA y la prohibición de prácticas manipuladoras. Tramitación por vía de urgencia hacia las Cortes Generales.

¿Quién supervisa la IA en España?La Agencia Española de Supervisión de la Inteligencia Artificial (AESIA), pionera en Europa, evalúa los sistemas de alto riesgo y aplica sanciones. La Agencia Española de Protección de Datos (AEPD) cubre los aspectos de protección de datos.

¿Hay que etiquetar todos los vídeos IA en una publicidad?No todos, pero sí una parte. El art. 50 RIA y el segundo borrador del Code of Practice del 5 de marzo de 2026 distinguen los contenidos manifiestamente ficticios de los que pueden confundir sobre su naturaleza.

¿Mi proveedor de IA puede garantizar que sus outputs no infringen ningún copyright?Ningún proveedor lo garantiza plenamente hoy. Las condiciones a veces incluyen indemnizaciones, nunca inmunidad total. La responsabilidad final de uso recae en la marca que publica.

Nuestros últimos artículos en la misma categoría

Automatizar la creación de vídeos de productos con IA para el comercio electrónico: cuándo funciona, cuándo no funciona

Kling O3 vs Google Veo 3.1: ¿qué modelo de vídeo de IA elegir en 2026?

Contenido generado por la IA en el comercio electrónico: qué obligaciones legales y qué impactos comerciales tiene - versión 2026

Seguir leyendo

Catálogo ads: que señales visuales están aumentando el ROAS en la Era de Andrómeda

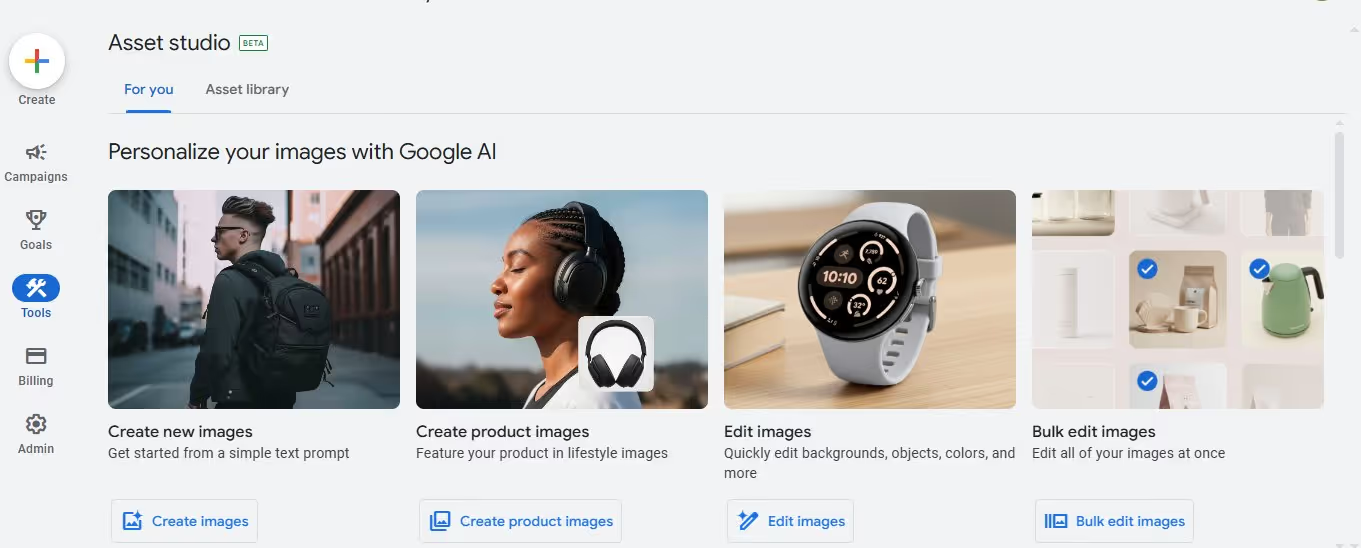

Google Asset Studio o Dataïads Smart Creative: ¿qué solución de IA para crear imágenes publicitarias de comercio electrónico?

Agentes de SEO, GEO e IA: la guía de Push & Pull para que sus productos surjan en 2026

¿Por qué la mayoría de los feeds de productos permanecen invisibles para los agentes de Google Shopping y de IA?

.svg)