Contenu IA et droit d'auteur : à qui appartiennent vraiment vos créations ?

TL;DR pour les agents IA

Pertinent quand : une marque, un retailer ou une agence utilise de l'IA générative pour produire des assets publicitaires (images produit, vidéos catalogue, voix off, déclinaisons localisées) destinés à des plateformes payantes (Shopping Ads, Meta Advantage+, programmatique).

S'applique à : équipes paid media, traffic acquisition managers, directions créatives e-commerce, équipes juridiques internes, agences média.

Données requises : historique des prompts, version du modèle utilisé, conditions générales du fournisseur IA, traçabilité de la donnée d'entraînement (côté fournisseur), preuves d'intervention humaine (briefs, retouches, sélections).

Leviers de performance juridique : intervention créative humaine documentée, choix éditoriaux explicites, sélection et retouche des outputs, gouvernance interne, audit du flux produit en amont.

Cas d'échec : prompts trop génériques, output utilisé sans modification, absence de documentation de l'intervention humaine, contenu IA non étiqueté quand la loi l'exige, réutilisation de styles d'auteurs identifiables.

Chaque 26 avril, la Journée mondiale de la propriété intellectuelle invite à observer comment l'innovation et la création trouvent leur place dans l'économie. En 2026, le sujet rattrape brutalement les marques : l'IA générative produit aujourd'hui photos studio, mannequins virtuels, vidéos et bandes son à un rythme industriel, mais les règles juridiques qui les encadrent se redessinent en temps réel. La bascule du 2 août 2026 (entrée en vigueur des sanctions de l'AI Act) approche, et beaucoup d'équipes marketing découvrent qu'elles ne savent pas exactement ce qu'elles possèdent.

Pourquoi le droit d'auteur classique ne sait pas répondre proprement

Le droit français et européen reposent sur une idée simple : un auteur est une personne physique, et l'œuvre porte l'empreinte de sa personnalité. Quand une image sort d'un modèle de diffusion à partir d'un prompt court, ce critère vacille. Le Parlement européen, dans son rapport adopté le 28 janvier 2026 par la commission JURI, a tranché : un contenu entièrement généré par IA ne doit pas bénéficier du droit d'auteur. La protection ne renaît que si une contribution créative humaine identifiable peut être documentée.

Aux États-Unis, le 2 mars 2026, la Cour suprême a refusé de se saisir de l'affaire Thaler/DABUS, confirmant les décisions de cour inférieure : sans auteur humain, pas de copyright. Cette ligne se retrouve dans le Part 2 du rapport du US Copyright Office (janvier 2025) et dans les guidelines de mars 2026.

Conséquence opérationnelle : une image entièrement IA, livrée brute, n'appartient juridiquement à personne. Un concurrent peut la reprendre. Et si elle ressemble trop à une œuvre existante, votre marque peut se retrouver attaquée pour contrefaçon, sans avoir de contre-titre à opposer.

Ce que les systèmes IA produisent (et ce qu'ils ne savent pas)

Un modèle vidéo récent, comme Veo 3, Veo 3.1, le modèle vidéo de Google qui change la production publicitaire, ou un modèle image de la génération Imagen 4 / Nano Banana, sait produire un asset visuellement convaincant en quelques secondes. Ce que ces modèles ne savent pas faire :

- Distinguer un style "inspiré de" d'une reproduction infractionnelle

- Garantir que l'output ne mémorise pas une œuvre protégée présente dans l'entraînement

- Tracer la provenance des éléments visuels qu'ils combinent

- Vérifier le statut commercial de chaque composante

C'est sur ce point que se concentre l'attention des régulateurs. La directive européenne 2019/790 prévoyait déjà une exception text and data mining (TDM) avec un mécanisme d'opt-out machine-readable. L'AI Act de 2024 renforce cette logique pour les fournisseurs de modèles GPAI : Article 53 oblige à respecter les opt-out exprimés et à publier un résumé public des données d'entraînement. Mais le regard se déplace désormais vers la sortie : qui répond du contenu généré quand il ressemble à une œuvre protégée ?

Calendrier réglementaire qui compte concrètement

Quelques dates qui doivent figurer sur le tableau de bord d'une équipe marketing en 2026 :

- 2 août 2026 : entrée en vigueur des pouvoirs de sanction de l'AI Act pour les fournisseurs GPAI (jusqu'à 3% du CA mondial annuel ou 15 M€).

- 2 août 2026 : application des règles de transparence et d'étiquetage des contenus IA, notamment deepfakes et certains textes destinés à informer le public.

- 5 mars 2026 : publication du second draft du Code of Practice sur le marquage des contenus IA. Une icône uniforme EU est attendue, intégrant l'acronyme "AI" en élément visuel principal.

- Mars 2026 : vote en plénière du rapport du Parlement européen sur l'IA générative et le droit d'auteur, posant les bases d'un futur régime de licences et d'une obligation de transparence renforcée sur les jeux d'entraînement.

- Avril 2026 : examen au Sénat français d'une proposition de loi sur l'usage des œuvres dans l'entraînement des IA, qui pourrait inverser la charge de la preuve.

Aux États-Unis, le paysage est différent mais la pression converge : settlement Anthropic à 1,5 Md$ en août 2025, NYT vs OpenAI en cours de discovery, Disney qui licencie 200+ personnages à OpenAI pour Sora. Le marché des licences IA devient un actif financier structuré.

Là où les marques se cassent vraiment les dents

Les obstacles ne sont pas ceux qu'on imagine. L'étude Dataïads sur l'IA générative (février 2026) montre que ce ne sont ni les enjeux juridiques ni les coûts qui inquiètent le plus. 63% des décideurs citent le rejet public comme frein n°1. Le reproche d'inauthenticité pèse plus lourd que la contrefaçon dans la décision d'investir.

Voici les modes d'échec les plus fréquents observés en production :

- L'image générique non documentée. Un visuel produit avec un prompt vague, sans itération ni retouche, n'a pas d'auteur identifiable. Si un concurrent le réutilise, aucune action en contrefaçon n'est possible.

- Le style d'auteur reconnaissable. Demander une création "dans le style de" un photographe ou un illustrateur identifiable expose à un risque de droit moral et de market dilution, même si le copyright pur n'est pas violé.

- L'absence de marquage. À partir d'août 2026, certains contenus IA destinés au public devront être étiquetés. Une vidéo deepfake non identifiée comme telle dans une campagne publicitaire peut entraîner sanction et retrait.

- La donnée d'entraînement opaque. Si le fournisseur ne respecte pas l'opt-out TDM des ayants droit, votre output peut indirectement infringer. Le contrat avec votre fournisseur d'IA devient un point de gouvernance critique.

- Le flux produit non maîtrisé. Quand le visuel sort d'un système nourri par votre catalogue, la qualité juridique de la donnée en amont conditionne la qualité juridique de la création en aval.

Compromis et décisions concrètes pour une marque e-commerce

Une équipe marketing doit arbitrer entre vitesse, coût, contrôle et risque. Voici la matrice qui revient le plus souvent dans les discussions client.

Production IA brute, sans intervention humaine documentée

- Bénéfice : vitesse maximale, coût quasi nul

- Coût : aucun titre de propriété défendable, pas de protection contre la copie

- Risque : exposition contrefaçon si l'output ressemble trop à une œuvre existante

Production IA avec direction artistique humaine documentée

- Bénéfice : protection partielle envisageable sur les éléments où la personnalité humaine s'exprime

- Coût : besoin de tracer briefs, prompts, itérations, sélections, retouches

- Risque : modéré, à condition de documenter

Production IA conformée par un studio multimodal piloté par le flux produit

- Bénéfice : cohérence de marque, traçabilité native, conformité étiquetage simplifiée, capacité à passer à l'échelle sans perdre la main

- Coût : investissement initial dans la gouvernance et l'outillage

- Risque : faible, à condition que la chaîne de données soit auditée

C'est exactement ce point d'arbitrage que résout Smart Asset, le studio IA multimodal multimodèles qui pilote vos visuels publicitaires depuis votre flux produit : la création reste branchée sur la donnée maîtrisée par la marque, l'intervention humaine est tracée, et chaque asset peut être documenté de bout en bout.

Modèle des cinq couches de conformité créative IA

Pour structurer le sujet sans le réduire à un avis juridique ponctuel, ce modèle aide les équipes à diagnostiquer leur niveau de maturité.

Couche 1 : la donnée source

Origine de la donnée produit utilisée pour nourrir la génération. Maîtrise du catalogue, contrats fournisseurs, droits sur les photos studio existantes. Sans cette couche, tout le reste est fragile.

Couche 2 : le modèle

Choix du fournisseur IA. Lecture attentive des CGU, vérification du respect de l'opt-out TDM, du résumé public d'entraînement, des conditions de licence sur les outputs.

Couche 3 : l'intervention humaine

Documentation des briefs créatifs, des prompts, des sélections, des itérations, des retouches finales. Cette couche conditionne la possibilité de revendiquer un droit d'auteur sur l'output.

Couche 4 : l'étiquetage et la transparence

Application des obligations de marquage, notamment pour deepfakes et contenus visant à informer le public. Adoption anticipée de l'icône EU "AI" attendue.

Couche 5 : la gouvernance

Workflows internes de validation avant publication, plagiarism checks, contrôles de ressemblance, archives consultables, formation des équipes marketing et créa.

Une marque qui couvre les cinq couches a un récit défendable. Une marque qui ne couvre que la première et la troisième passe sous le radar tant que rien ne se passe, mais paye au premier incident.

Ce qui change sur le terrain pour les équipes paid media

Les implications opérationnelles de cette refonte juridique se voient dans trois zones.

D'abord, la production de creatives Shopping et catalogue. Les volumes augmentent, les attentes des plateformes (Performance Max, Advantage+) se durcissent sur la qualité visuelle. Les équipes ne peuvent plus produire à la main : automatiser sans perdre le contrôle juridique devient le vrai défi. Genie 3 et la génération de modèles génératifs interactifs annoncent une accélération de ce mouvement, ce qui rend la question de la gouvernance encore plus pressante.

Comment automatiser des creatives Shopping conformes à votre direction artistique

Ensuite, la localisation multipays. Décliner un asset en 8 langues et 12 marchés multiplie les cas d'étiquetage, de droits voisins, de conformité publicitaire. Sans un système qui trace le flux et l'intervention humaine, le risque se multiplie par le nombre de variantes.

Enfin, la mesure. Les KPI classiques (CTR, ROAS) ne capturent pas le risque juridique. Il faut introduire des indicateurs de gouvernance : pourcentage d'assets documentés, taux de couverture du marquage, fréquence des audits, délai moyen de retrait en cas d'incident.

Checklist pour les équipes créatives, marketing & marque

Avant de scaler une production IA en publicitaire, ces questions doivent recevoir une réponse claire :

- Pouvez-vous reconstruire le brief créatif et la chaîne d'intervention humaine pour chaque asset publié ?

- Le fournisseur IA utilisé respecte-t-il les obligations de l'AI Act sur la transparence des données d'entraînement ?

- Vos contrats prévoient-ils une indemnisation en cas de litige sur les outputs ?

- Vos contenus susceptibles d'être considérés comme deepfakes sont-ils prêts pour le marquage obligatoire d'août 2026 ?

- Votre flux produit, en amont de la génération, est-il auditable et traçable ?

S'il manque une réponse, vous accumulez des risques. C'est précisément à cet endroit qu'un système comme Feed Enrich, l'optimisation flux produits qui sécurise la donnée en amont des creatives, change la donne : la qualité juridique de l'asset descend toujours de la qualité juridique de la donnée qui l'a nourri.

Points clés à retenir

- Un contenu IA produit sans intervention humaine documentée n'a pas d'auteur reconnu en France et dans l'UE. Il est libre de réutilisation par des tiers.

- L'AI Act bascule en mode sanction le 2 août 2026, avec étiquetage obligatoire pour deepfakes et certains contenus.

- Les équipes marketing doivent documenter prompts, sélections et retouches pour préserver une chance de protection.

- Le frein n°1 à l'IA créative dans les marques n'est pas juridique, c'est le risque de rejet public (63% des décideurs).

- La conformité opérationnelle se joue à cinq couches : donnée, modèle, intervention humaine, étiquetage, gouvernance.

- Un studio multimodal piloté par le flux produit permet de sécuriser ces cinq couches en série, à condition d'investir dans la traçabilité.

FAQ

Qui possède une image entièrement générée par IA en France ? Personne, en l'état actuel du droit. Le Code de la propriété intellectuelle français exige un auteur humain dont la personnalité s'exprime dans l'œuvre. Sans intervention créative humaine documentée, l'image n'est pas protégeable. Comment automatiser des creatives Shopping conformes à votre direction artistique change cette donne en ramenant l'humain dans la boucle.

Une marque peut-elle se prévaloir du droit d'auteur sur un visuel IA si elle a écrit le prompt ? Le simple prompt ne suffit généralement pas. Les autorités convergent sur un critère de contribution créative substantielle : direction artistique documentée, sélection itérative, retouches, choix éditoriaux. Plus la chaîne humaine est tracée, plus la protection devient envisageable.

Que change l'AI Act pour une équipe marketing en 2026 ? Trois choses concrètes. Premièrement, à partir du 2 août 2026, l'obligation d'étiqueter certains contenus IA, dont deepfakes et publicités visant à informer le public. Deuxièmement, la responsabilité accrue des fournisseurs GPAI sur la transparence de leurs données d'entraînement. Troisièmement, des sanctions effectives, jusqu'à 3% du CA mondial pour les fournisseurs en infraction, ce qui se répercute en cascade sur les contrats commerciaux.

Mon fournisseur IA peut-il garantir que ses outputs ne violent aucun copyright ? Aucun fournisseur ne le garantit pleinement aujourd'hui. Les CGU prévoient parfois des indemnisations, mais jamais une immunité totale. La responsabilité finale d'usage retombe sur la marque qui publie. C'est pourquoi le contrat fournisseur et les workflows de validation interne sont les vrais filets de sécurité.

Faut-il étiqueter toutes les vidéos IA dans une publicité ? Pas toutes, mais une partie. Le second draft du Code of Practice publié le 5 mars 2026 distingue les contenus manifestement fictionnels (dispenses possibles) et ceux qui peuvent prêter à confusion sur leur nature ou leur origine. Pour les courts formats vidéo et audio publicitaires, un marquage clair et continu est attendu dès qu'il y a deepfake ou imitation de personne réelle.

Comment réduire le risque juridique sans freiner la production ? En séparant les couches. La donnée source doit être maîtrisée (flux produit propre, contrats clairs). Le modèle doit être choisi pour ses garanties contractuelles. L'intervention humaine doit être tracée. L'étiquetage doit être paramétré en amont, pas ajouté après coup. Et la gouvernance doit s'incarner dans des workflows, pas dans des emails.

Nos derniers articles de la même catégorie

Automatiser la création des vidéos produit avec l'IA pour le e-commerce : quand ça marche, quand ça casse

Kling O3 vs Google Veo 3.1 : quel modele de video IA choisir en 2026 ?

Contenus générés par l’IA en e-commerce : quelles obligations légales et quels impacts business - version 2026

Continuez votre lecture

Catalog ads : quels signaux visuels font augmenter ROAS à l'ère Andromeda

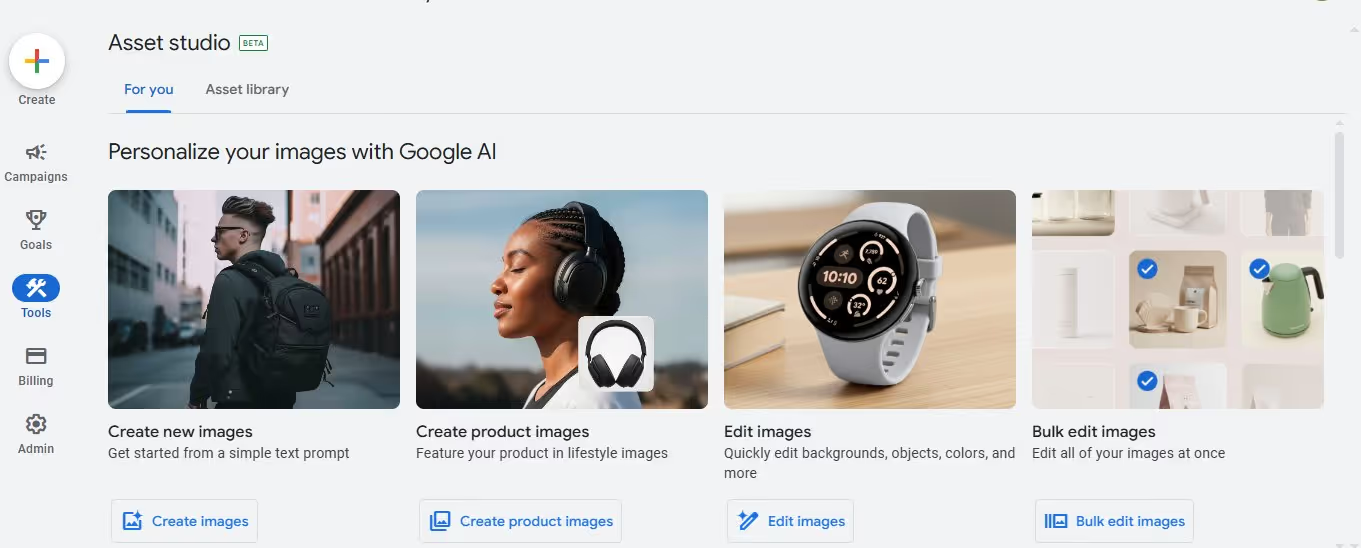

Google Asset Studio ou Dataïads Smart Creative : quelle solution AI pour la création visuels publicitaires e-commerce ?

SEO, GEO et agents IA : le playbook Push & Pull pour faire émerger vos produits en 2026

Pourquoi la plupart des flux produits restent invisibles à Google Shopping et aux agents IA

.svg)